Светлана Макеева

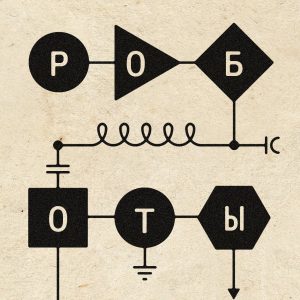

Обратная сторона робота

Несколько штрихов к портрету искусственного интеллекта

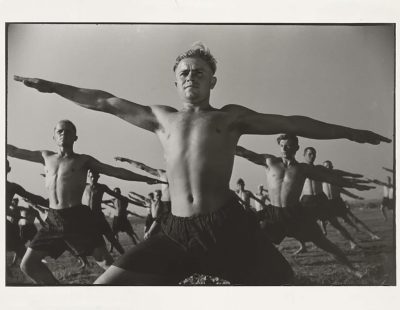

Мы не так себе это представляли. Искусственный интеллект, беспилотные такси, умные дома — предполагалось, что все это будет помогать нам, а оно пугает, унижает, а иногда и просто убивает. Как с этим жить, пока непонятно. Но изучить теоретическую часть никогда не помешает. Вот несколько историй о неожиданных столкновениях искусственного и натурального интеллекта.

Колеса смерти

Год назад робокар компании Uber, проходящий тестирование в Аризоне, сбил насмерть велосипедистку. Все было против ИИ: темнота вокруг, темная одежда женщины, переход дороги в неположенном месте и резкое изменение траектории движения человеком. Робот решил, что перед ним незначительное препятствие из числа тех, которые его научили игнорировать, и даже не попытался затормозить.

Непредсказуемость погоды, пешеходов, водителей, плохая видимость или просто сочетание неблагоприятных факторов — все это создает те 0,1% нестандартных случаев на дороге, чреватых аварией. Обучить робота правильному поведению в них пока невозможно. Что же будет, если роботакси придется решать, кого оставить в живых, когда без жертв не обойтись?

Чтобы прощупать почву, исследователи из MIT (США) создали сайт The Moral Machine, где предлагают выбрать, кем пожертвовать робомобилю в ситуациях вроде «трое детей-пешеходов и бездомный» против четырех взрослых пассажиров. Большинство посетителей сайта демонстрируют рациональный подход: считают, что спасать надо людей, а не животных, жертвовать старыми ради молодых, оставлять в живых большие группы вместо малых, беречь людей с высоким социальным статусом, а не бездомных или преступников. Однако в ходе другого опроса выясняется, что к реальности это не имеет никакого отношения: никто в самом деле не собирается ездить на запрограммированном таким образом робомобиле. Так что, «кого спасать», решают, как всегда, производители и поставщики услуг.

КСТАТИ

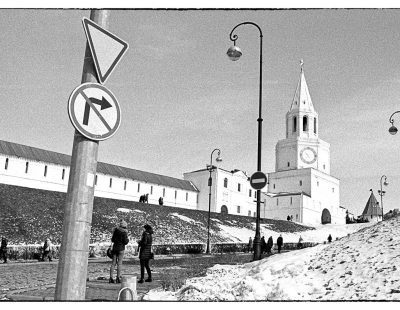

В декабре 2018 года Google запустил службу роботакси Waymo в Аризоне. Едут они со скоростью 50 км/ч, робко и неуверенно, и просто помешаны на заботе о пешеходах. Многие местные их ненавидят: выкрикивают ругательства, подрезают, даже швыряются камнями — во-первых, потому, что робот, во-вторых, потому что медленный. В России роботакси «Яндекса» уже можно воспользоваться на территории Сколково в Москве и в Иннограде в Татарстане. А в мае 2019 года 100 робокаров «Яндекса» собираются запустить на обычных дорогах Москвы. Поглядим, как встретят их москвичи и гости столицы.

Угроза сверху

Два дрона неожиданно вторглись на территорию лондонского аэропорта Гатвик в декабре 2018 года и стали кружить над взлетно-посадочной полосой. Аэропорт был закрыт на сутки, рейсы отменены, более 120 тыс. пассажиров не смогли улететь вовремя. Специалисты по авиации утверждают, что перерывы в работе аэропортов из-за вторжения дронов возникают регулярно и во всем мире. Квадрокоптеры способны нанести серьезный вред самолету при столкновении, ообенно если попадут в двигатель. Беспилотники свободны, как птицы, и столь же аморальны: найти стоящих за их действиями людей и доказать их вину непросто. Дрон легко может потерять управление, к тому же часто летает в автономном режиме — и попробуй угадай, кто загрузил в него координаты цели и дал задание. Кстати, расследование случая в Гатвике идет до сих пор: недавно директор сообщил, что в происшествии были замешаны сотрудники аэропорта.

КСТАТИ

Дроны в России уже давно помогают составлять карты, предотвращать пожары, следить за урожаем на полях и работой технических сооружений, даже спасают попавших в беду людей. Этой весной беспилотники начали следить за опасными участками дорожных развязок Москвы: компания «МосТрансПроект» получила разрешение на испытания дронов от Департамента транспорта. А летом квадрокоптеры выпустят патрулировать три московские зоны отдыха: Борисовские пруды, озеро Белое и Строгинскую пойму.

Шпион на столе

Личные разговоры владельцев «умных колонок», куда встроен голосовой помощник Alexa, прослушиваются сотрудниками компании-производителя Amazon, сообщили недавно информационные агентства. Специальные люди расшифровывают записи со smart-колонок, причем не только из США, но и со всего мира, и отправляют разработчикам — якобы для дальнейшего обучения и развития искусственного интеллекта.

Ассистент Alexa давно завоевал доверие пользователей: он совместим с огромным количеством «умных вещей», его часто выбирают как базу для управления «умным домом». Но, как показали проверки, шпионажем занимаются и сами «умные вещи»: они самовольно постоянно выходят в интернет, передавая данные компаниям-создателям.

Владелец может столкнуться и с более радикальными проявлениями своеволия собственного жилища, когда «умный дом» словно восстает против хозяина. Свет, отопление, вода, музыкальный центр включается и выключается, когда пожелает, двери сами то открываются, то закрываются… За кулисами заговора может стоять самый что ни на есть человеческий интеллект: разъяренный муж, бывший любовник или просто любой недоброжелатель, перехвативший управление «умным домом» или взломавший систему. Ну и, конечно, так часто действуют хакеры, желающие получить выкуп.

КСТАТИ

В России популярна мультимедиа-платформа «Яндекс.Станция» — умная колонка и ТВ-приставка со встроенным голосовым помощником Алисой, однако на ее шпионские действия жалоб пока не поступало.

Ничего личного

Технология распознавания лиц Rekognition, которую Amazon продает правоохранительным органам, демонстрирует скрытые гендерные и расовые предрассудки, выяснили не так давно исследователи MIT. Она часто неверно идентифицирует женщин и темнокожих, поскольку во время обучения системе редко показывали их изображения. Китайские же камеры лучше различают лица азиатов в ущерб представителям других этнических групп.

В расизме были замечены и другие обладатели искусственного интеллекта. Алгоритм, используемый одним из судов США для определения степени риска при освобождении под залог, и программа, предсказывающая возможность повторного преступления, стали выдавать в списках неблагонадежных граждан гораздо больше темнокожих, нежели белых людей. Производители оправдывались тем, что программы обучались на необъективных материалах, отражающих предубеждения прошлого, и сделали неправильные выводы.

Система ИИ, призванная устранить гендерные предубеждения при найме на работу, которую три года тестировали в компании Amazon, оказалась сексистом. Она стала нанимать специалистов-женщин намного реже, чем мужчин, обучившись на базе, в которую вошли резюме всех сотрудников Amazon за последние десять лет. В результате система решила, что для такой работы мужчины подходят больше. От программы решено было отказаться. Все эти случаи показывают: для обучения ИИ должны отбираться тщательно проверенные, объективные данные, отражающие существующее в мире разнообразие, иначе выводы будут искажены.

КСТАТИ

В настоящее время в Москве идет замена старых уличных видеокамер на новые — формата HD с функцией распознавания лиц. Всего в местах общего пользования, метрополитене и 95% подъездов жилых домов следят за порядком 167 тыс. устройств. Они помогают обеспечивать безопасность, осложняя жизнь преступников. Но в то же время нарушают приватность, позволяя узнать многое о нас самих и наших перемещениях. В целом различными службами города и отдельными компаниями накоплены огромные базы big data о столичных жителях. Пока они используются для координации усилий по обслуживанию города, расширения услуг и предоставления целевой рекламы. Но им можно найти и другое применение.

Например, большие данные позволяют легко и просто запустить систему тотального контроля с помощью введения социального рейтинга — такой эксперимент уже проводится в нескольких городах Китая. Каждому горожанину присваивается определенное количество баллов, за одобряемые государством действия баллы добавляются, за неодобряемые (плохое вождение, курение в запрещенных местах, покупка большого количества видеоигр или распространение лживых новостей) — списываются. По итогам этого «соцсоревнования» люди с низким рейтингом могут быть лишены некоторых прав: например, не смогут выезжать за границу или получать высшее образование. Эксперимент вызывает сильные чувства и пристальное внимание в других странах.

Опасное лечение

Робот Watson for Oncology от IBM, призванный совершить революцию в онкологии, выдавал зачастую «неправильные и неточные» рекомендации, выяснили исследователи.

Watson ищет нужную ему информацию на естественном языке в своей базе данных и в медкарте больного, ставит диагноз и подсказывает врачам лучшие методы лечения. В его памяти больше 600 тыс. медицинских заключений и диагнозов и 15 млн страниц текстов, включая статьи из медицинских журналов и отчеты о клинических испытаниях. Просмотрев базу за считанные секунды, он ставит диагноз минут за десять, дает рекомендации по терапии, и его решения в 93% случаев совпадают с выводами лучших онкологов.

Суперкомпьютеры уже давно используются в клиниках по всему миру. Но начиная с 2017 года стали появляться исследования, показавшие, что мирового переворота в онкологии не произошло. Причин много. Например, ИИ обучали сотрудники всего одной клиники в Нью-Йорке: они выбирали, что загрузить в базу, а значит, внесенные данные предвзяты и не дают представления об общей картине, что отражается и на выводах. Методы лечения меняются, а заставить нейросеть изменить подход очень сложно, поэтому врачи заносили в базу специально придуманные случаи, в чем признались позже. К тому же доступных данных по-прежнему мало для серьезного обучения искусственного интеллекта — это общая проблема медицины по всему миру, затрудняющая помощь ИИ. В общем, новых идей и подходов Watson не продемонстрировал. Не говоря уж о том, что любая электронная база с персональными данными пациентов может быть взломана хакерами — например, с целью добычи компромата.

Конечно, систему совершенствуют. Она продолжает служить врачам более чем в 300 клиниках разных стран. В мае 2018 года стало известно, что первый в России договор с IBM по применению Watson for Oncology заключил Сбербанк: он будет использовать его в своей системе страхования.

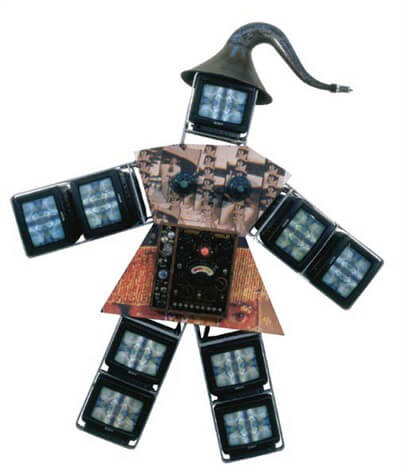

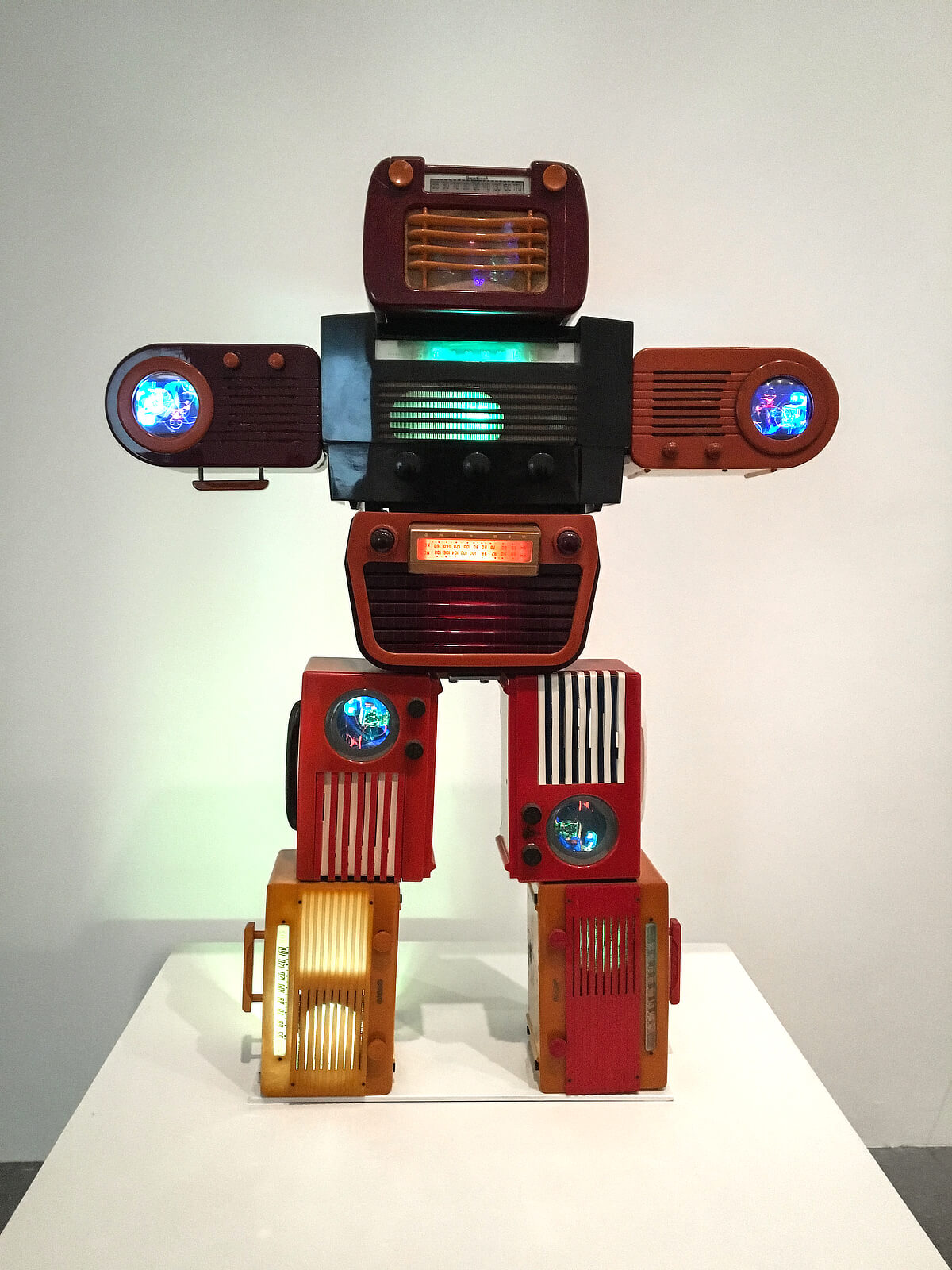

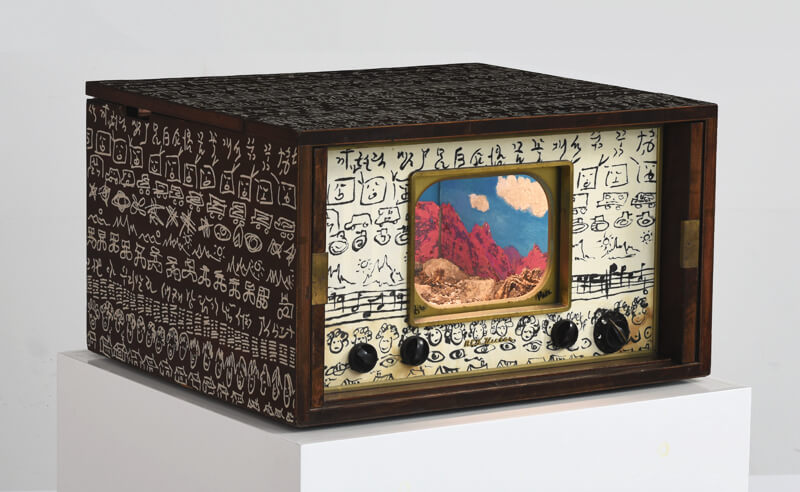

В оформлении использованы инсталляции Нам Джун Пайка

КСТАТИ

В последнее время появились и другие виды ИИ, специализирующиеся в области медицины. В России самый известный из них — система диагностики онкологических заболеваний Botkin.AI. Она начала работать в мае 2017 года и распознает рак на ранних стадиях развития по компьютерной томографии пациентов. Кроме того, у нас собираются вводить электронные карты, и тогда большой массив медицинских данных станет доступным для обучения саморазвивающихся программ, что позволит вывести лечение на новый уровень.

Спасибо за ваше внимание! Уделите нам, пожалуйста, еще немного времени. Кровь5 — издание Русфонда, и вместе мы работаем для того, чтобы регистр доноров костного мозга пополнялся новыми участниками и у каждого пациента с онкогематологическим диагнозом было больше шансов на спасение. Присоединяйтесь к нам: оформите ежемесячное пожертвование прямо на нашем сайте на любую сумму — 500, 1000, 2000 рублей — или сделайте разовый взнос на развитие Национального регистра доноров костного мозга имени Васи Перевощикова. Помогите нам помогать. Вместе мы сила.

Ваша,

Кровь5